Dlaczego AI nie jest nieprzewidywalne – tylko my nie widzimy procesu

Na poziomie użytkowym modele językowe wydają się niedeterministyczne. Ten sam prompt daje różne odpowiedzi, podobne zadania prowadzą do innych wyników, a próba powtórzenia „tego jednego idealnego efektu” często kończy się odchyleniem, którego nie da się łatwo wyjaśnić.

Najczęściej zatrzymujemy się na tej obserwacji.

Model jest niedeterministyczny.

To jednak tylko opis powierzchni. Nie mechanizmu.

Niedeterminizm jako skrót myślowy

Niedeterminizm w modelach językowych nie oznacza chaosu. Oznacza brak jednej ścieżki prowadzącej do wyniku.

Model nie „wybiera odpowiedzi”.

Model buduje ją sekwencyjnie, token po tokenie, na podstawie:

- wcześniejszego kontekstu,

- statystycznych zależności,

- wewnętrznego stanu reprezentacji,

- parametrów generacji,

- oraz – co kluczowe – interpretacji zadania.

To ostatnie jest pomijane najczęściej.

Model nie dostaje zadania w postaci jednoznacznej specyfikacji.

Dostaje tekst, który musi zinterpretować.

Każda odpowiedź to ciąg mikrodecyzji

W praktyce oznacza to, że każda odpowiedź powstaje jako wynik tysięcy mikrodecyzji:

- co jest właściwym kontekstem zadania,

- jaki poziom szczegółowości przyjąć,

- czy odpowiedź ma być ostrożna czy stanowcza,

- czy skupić się na ogólności czy przykładach,

- które wątki uznać za centralne,

- które pominąć,

- jaką strukturę przyjąć,

- gdzie zakończyć.

Te decyzje nie są losowe. Są optymalizowane względem modelu.

Ale nie są też w pełni kontrolowane przez użytkownika.

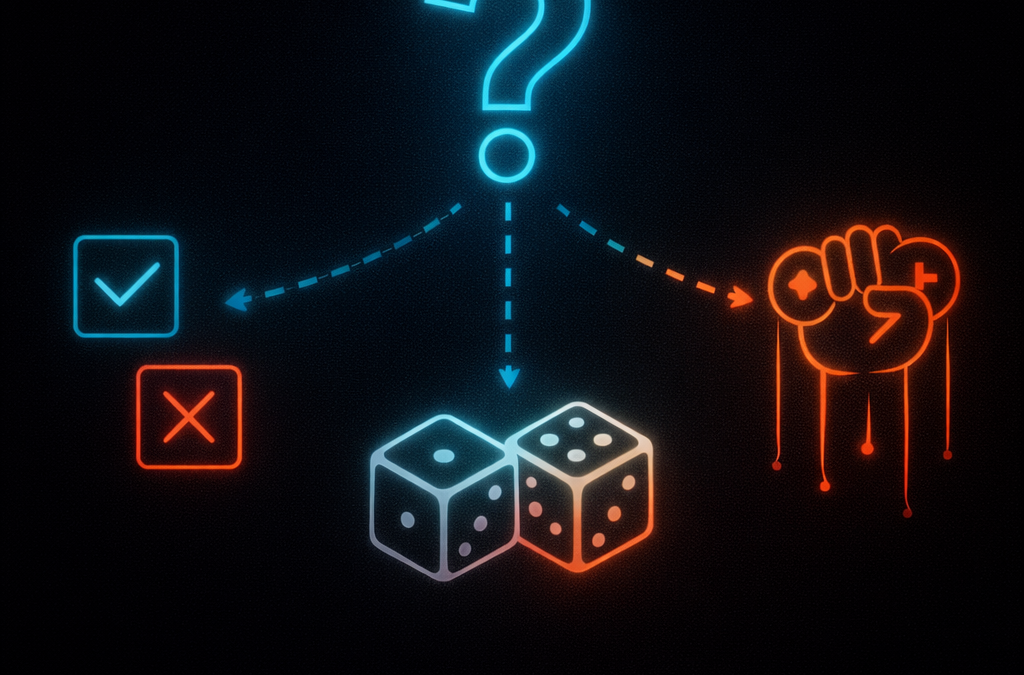

Delegacja decyzji jako źródło „nieprzewidywalności”

W tym miejscu pojawia się kluczowe przesunięcie:

niedeterminizm nie wynika wyłącznie z modelu

wynika z delegacji decyzji

Jeżeli zadanie jest ogólne, model musi:

- zdefiniować problem,

- dobrać ramę interpretacyjną,

- ustalić kryteria jakości,

- a dopiero potem wygenerować odpowiedź.

Czyli wykonuje pracę, która normalnie należałaby do człowieka.

W efekcie im więcej decyzji oddajesz modelowi, tym mniej kontrolujesz wynik.

I to jest postrzegane jako niedeterminizm.

Iluzja stabilności wyniku

Model potrafi generować odpowiedzi, które są:

- poprawne językowo,

- logiczne,

- spójne,

- przekonujące.

To tworzy silne złudzenie:

wynik jest stabilny, więc proces też był stabilny

To błąd.

Stabilny może być efekt powierzchniowy.

Proces, który do niego doprowadził, może być zupełnie inny.

Dwie odpowiedzi mogą wyglądać podobnie, ale:

- opierać się na innych założeniach,

- wynikać z innej interpretacji pytania,

- prowadzić do innych wniosków przy rozwinięciu.

To jest szczególnie istotne w analizie, architekturze, bezpieczeństwie.

AI jako system optymalizacji, nie zrozumienia

Modele językowe nie „rozumieją” problemu w sensie ludzkim.

Optymalizują odpowiedź względem:

- prawdopodobieństwa,

- wzorców z danych,

- oraz zgodności z kontekstem.

To oznacza, że:

- poprawna odpowiedź może być wynikiem dopasowania,

- a nie rekonstrukcji mechanizmu.

I tu pojawia się fundamentalna luka:

użytkownik widzi wynik, ale nie widzi procesu decyzyjnego

Problem: zgodność ≠ trafność

Jedną z najbardziej niebezpiecznych konsekwencji jest utożsamienie:

- odpowiedzi spójnej → z odpowiedzią trafną

- odpowiedzi przekonującej → z odpowiedzią poprawną

Model jest bardzo dobry w generowaniu odpowiedzi, które:

- brzmią jak eksperckie,

- są strukturalnie poprawne,

- mieszczą się w znanych wzorcach.

Ale:

- nie musi to oznaczać, że przyjęte założenia były właściwe,

- ani że proces był zgodny z rzeczywistością.

RAG, kontekst i dryf interpretacyjny

Często zakłada się, że problem niedeterminizmu można rozwiązać przez:

- dostarczenie kontekstu (RAG),

- ograniczenie danych wejściowych,

- zawężenie zadania.

To działa częściowo.

Ale nie eliminuje kluczowego problemu:

interpretacji kontekstu

Model nadal musi zdecydować:

- które elementy są istotne,

- jak je powiązać,

- które priorytety przyjąć.

Czyli mikrodecyzje nie znikają.

Zmienia się tylko ich przestrzeń.

Niedeterminizm jako właściwość systemu, nie błąd

Z tej perspektywy niedeterminizm przestaje być problemem technicznym.

Staje się właściwością systemu:

- otwartego,

- kontekstowego,

- zależnego od interpretacji.

To oznacza, że:

- nie da się go „wyłączyć”,

- można jedynie ograniczyć jego zakres.

Granica: gdzie kończy się kontrola użytkownika

Kluczowe pytanie nie brzmi więc:

jak uzyskać zawsze ten sam wynik

Tylko:

które decyzje chcę zachować po swojej stronie

Bo każdy element, którego nie określisz:

- zostanie uzupełniony przez model,

- zgodnie z jego optymalizacją,

- nie Twoją intencją.

Systemowy efekt uboczny: centralizacja rozumienia

Na poziomie organizacji prowadzi to do jeszcze jednego zjawiska.

Jeżeli:

- większość pracy jest delegowana do AI,

- a tylko część osób rozumie mechanizmy,

- reszta operuje na wynikach,

to powstaje system, w którym:

- wiedza jest skoncentrowana,

- decyzje są rozproszone,

- odpowiedzialność jest niejasna.

I wtedy:

problemem nie jest AI

problemem jest brak widoczności procesu

Najważniejszy wniosek

Modele językowe nie są nieprzewidywalne w sensie losowości.

Są nieprzewidywalne w sensie niewidoczności procesu decyzyjnego.

A to są dwie zupełnie różne rzeczy.

Punkt, w którym zaczyna się kontrola

Kontrola nad AI nie polega na:

- znalezieniu idealnego promptu,

- ani na wymuszeniu jednego wyniku.

Polega na:

- ograniczaniu przestrzeni decyzji,

- ujawnianiu założeń,

- rozbijaniu zadań na etapy,

- oraz świadomym decydowaniu, co zostaje po stronie modelu.

Ostatecznie

Niedeterminizm nie zaczyna się w modelu.

Zaczyna się w miejscu, w którym użytkownik przestaje definiować problem.

A kończy się tam, gdzie wynik wygląda na wystarczająco dobry, żeby przestać zadawać pytania.

I właśnie dlatego najbardziej ryzykownym momentem w pracy z AI nie jest błąd.

Tylko moment, w którym odpowiedź wydaje się poprawna.